深度学习

AI 的“智慧引擎”

概述

多层结构驱动AI“理解世界”的力量

关键要点

- 多层结构自动特征提取

- 需大量数据与算力

- 支持非结构化数据

应用场景

- 图像与语音理解

- 文本生成与翻译

- 自动驾驶与推荐系统

常见误区

- 训练成本高

- 数据质量决定效果

📚 简单定义

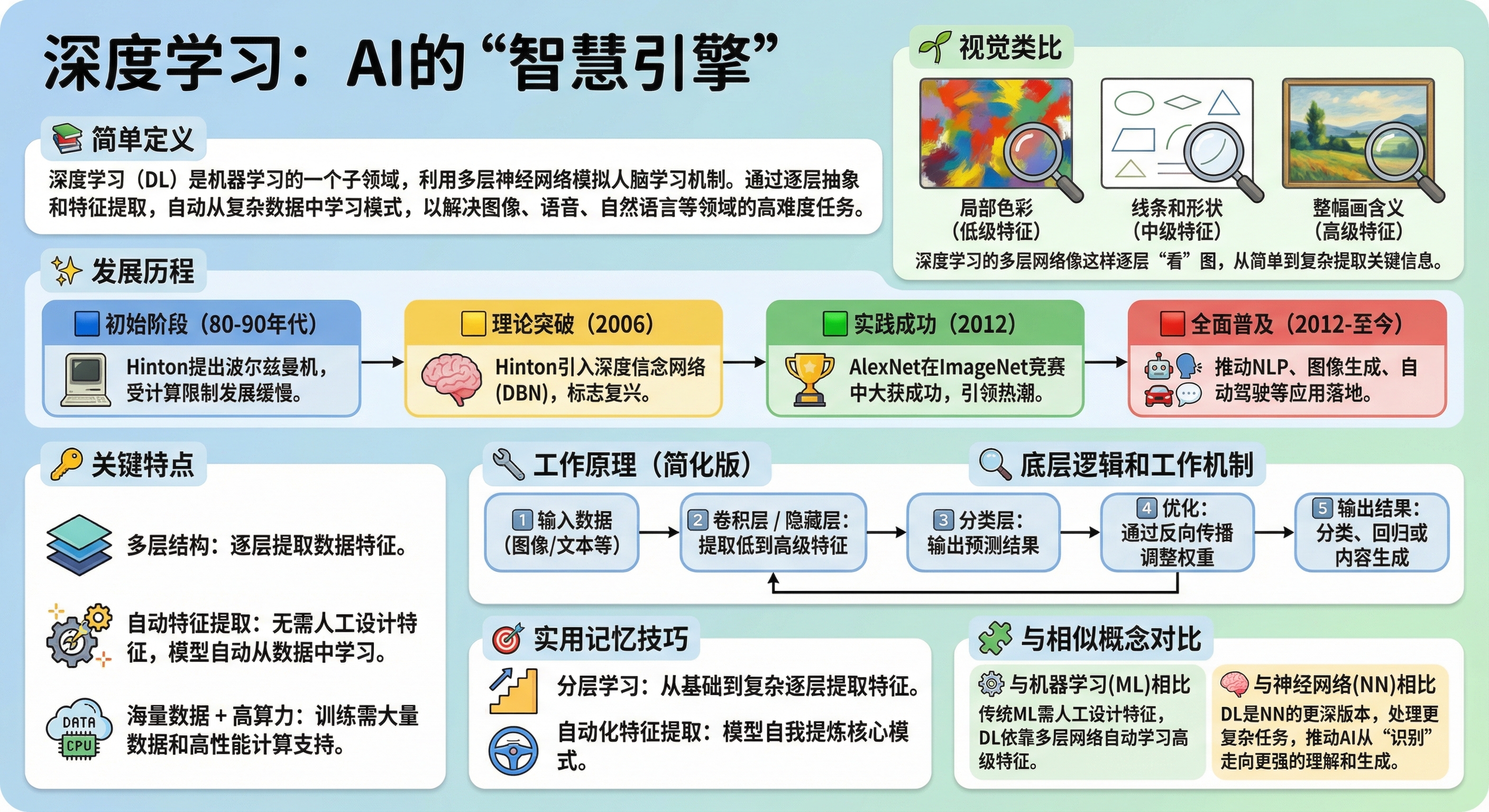

深度学习(Deep Learning, DL)是机器学习的一个子领域,利用多层神经网络模拟人脑的学习机制。通过层层抽象和特征提取,深度学习能够自动从复杂数据中学习模式,用于解决图像、语音和自然语言等领域的高难度任务。

🌱 形象类比

想象你在看一幅复杂的画作,先从局部颜色(低层特征)观察起,然后分析线条和形状(中层特征),最后理解整个画面的意义(高层特征)。深度学习的多层网络就是这样逐层“看图”,从简单到复杂提取关键信息。

✨ 发展历史

🟦 起步阶段(20 世纪 80-90 年代) 1980 年代 Hinton 提出玻尔兹曼机等概念,但受算力限制发展缓慢。

🟨 理论突破(2006 年) Hinton 提出深度信念网络(DBN),标志深度学习重新兴起。

🟩 实践成功(2012 年) AlexNet 在 ImageNet 竞赛中大获成功,深度学习崭露头角。

🟥 全面普及(2012 年至今) 推动自然语言处理、图像生成、自动驾驶等领域的技术突破和应用落地。

🔑 关键特征

- 多层结构:逐层提取数据特征。

- 自动特征提取:无需人工设计特征,模型从数据中自动学习。

- 海量数据 + 高算力:深层网络训练需要大量数据与高性能计算支持。

🔧 工作原理(简化版)

1️⃣ 输入数据(图像 / 文本等)

↓

2️⃣ 卷积层 / 隐藏层:提取低级到高级特征

↓

3️⃣ 分类层:输出预测结果

↓

4️⃣ 优化:反向传播调整权重

↓

5️⃣ 输出结果:分类、回归或生成内容

🔍 背后逻辑与工作机制

深度学习通过多层神经网络逐步分解任务:输入层接收原始数据,隐藏层逐步提取特征,输出层完成分类、回归或生成;反向传播不断调整参数以优化性能,擅长处理非结构化数据如图像、音频和自然语言。

🎯 实用记忆小技巧

- 逐层学习:从基础到复杂逐步提取特征。

- 自动化特征提取:模型自行提炼核心模式。

🧩 相似概念对比

- 与机器学习(ML):传统 ML 需人工特征,DL 依赖多层网络自动学习高级特征。

- 与神经网络(NN):DL 基于 NN 的更深版本,能处理更复杂任务,推动 AI 从“识别”到更强的理解与生成。