上下文工程

让 AI 不走神的关键手艺

概述

通过筛选和组织关键信息,让模型在有限窗口里更准确地理解目标与约束。

关键要点

- 上下文是有限资源,精准比全面更重要

- 先给角色与任务,再给细节

- 长任务需要压缩记忆与按需加载

应用场景

- 多轮对话与 Agent 任务编排

- 长文档总结与信息提取

- 复杂流程中的工具调用与约束管理

常见误区

- 堆太多无关信息导致注意力稀释

- 缺少目标与约束让模型跑偏

- 不做阶段性总结导致上下文“腐烂”

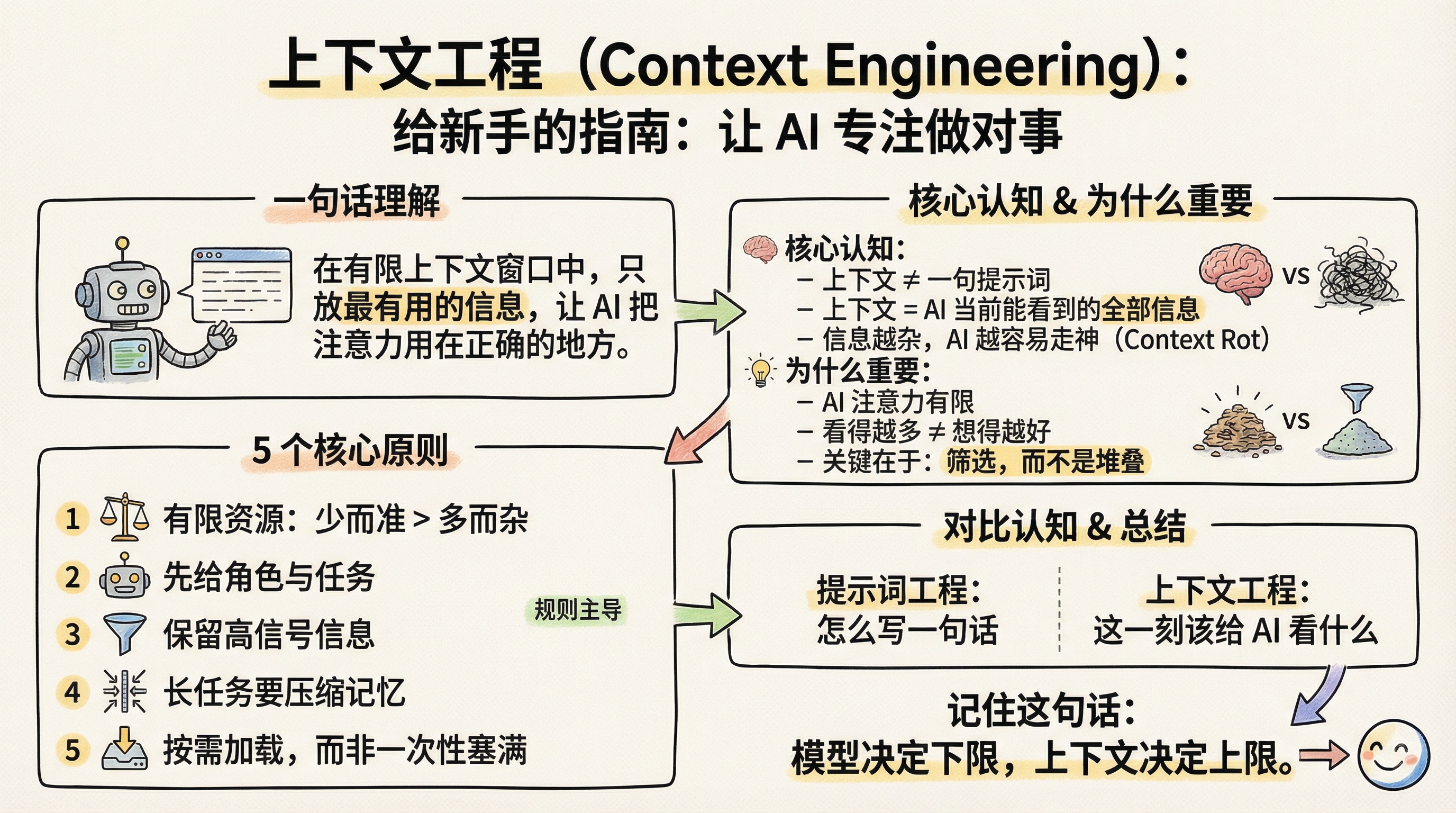

🧠 上下文工程(Context Engineering):决定 AI“聪不聪明”的隐藏因素

📖 基本概念与类比

📚 简单定义

上下文工程(Context Engineering),是指如何为 AI 组织、提供和管理上下文信息,让它在有限的上下文窗口中,尽可能准确地理解你的问题、目标和约束。

🌱 形象类比

你和一个人沟通时,如果不说背景、不说目标、不说限制条件,对方只能“凭感觉猜”。AI 也是一样。上下文工程,就是在“正式提问之前”,先把该交代的背景、规则和关键信息交代清楚。

🔥 为什么从「提示工程」进化到「上下文工程」?

早期用 AI,大家关注的是:这句话该怎么写,AI 才听话?

但随着 AI 开始做更复杂的事(多轮对话、Agent、长任务),问题变成了:“在这一刻,我应该把哪些信息交给 AI?”

因为 AI 能看到的信息是有限的,而且——信息越多,越容易“走神”;信息越杂,越容易抓错重点。

在 AI 领域,这有一个形象的说法:👉 上下文会“腐烂”(Context Rot)

不是模型变笨了,而是注意力被稀释了。

🧩 核心要点

🛠️ 上下文工程的 5 个核心原则(科普版)

1️⃣ 上下文是一种「有限资源」|不是越多越好,而是越准越值钱

AI 不是看得越多越好,而是看对,比看全更重要。多一条没用的信息,就少一分注意力给关键信息。

2️⃣ 先给“角色与任务”,再给细节|方向不清,AI 一定用错力

一开始就说明你在做什么、AI 要扮演什么角色、成功的标准是什么,否则 AI 很容易跑偏。

3️⃣ 保持上下文「紧凑而有信号」|堆材料不如筛重点

好的上下文不是信息越多越好,而是保留决定方向的内容,删除已经没用的中间过程。

4️⃣ 长任务要学会“压缩记忆”|不整理,AI 迟早会迷路

当对话变长、任务变复杂时,总结阶段性结论,把关键决定压缩成几条笔记,再继续往下走。

5️⃣ 不是一次性喂完,而是“按需加载”|需要时再给,才不浪费注意力

人不会把整本书背下来再做事,优秀的 AI 也一样:需要时,再把相关信息放进上下文。

🔍 背后逻辑与工作机制

上下文工程的核心目标,是在有限的上下文窗口中,筛选并保留最有价值的信息。这不是简单的信息堆叠,而是一种有选择、有权重的组织过程:根据当前任务动态决定哪些信息进入上下文,哪些应当被省略或压缩,从而避免模型注意力被无关内容稀释。

🧠 提示词工程 vs 上下文工程

| 维度 | ✍️ 提示词工程(Prompt Engineering) | 🧠 上下文工程(Context Engineering) |

|---|---|---|

| 本质 | 写好一段高质量指令 | 动态构建最优上下文 |

| 发生时机 | 开发阶段,一次写好 | 每一轮交互,持续调整 |

| 性质 | 静态、一次性 | 动态、持续、自适应 |

| 关注点 | “这句话怎么写才听话?” | “这一刻该让 AI 看到什么?” |

| 目标 | 单次任务做到最好 | 连续交互中记忆、学习、进化 |

| 适合场景 | 一问一答、简单生成 | Agent、多轮对话、长任务 |

🎯 实用记忆小技巧

上下文工程不是高级黑科技,而是一种新的沟通常识。

同一个 AI、同一个模型:

- 上下文混乱 → 看起来很笨

- 上下文清晰 → 像换了一个人

模型决定下限,但上下文决定上限。