神经网络

AI 的"智慧架构"

概述

构建AI大脑的神经元集合

关键要点

- 多层结构

- 权重可学习

- 表达能力强

应用场景

- 图像与语音识别

- 文本理解

- 模式预测

常见误区

- 结构复杂 ≠ 自动更聪明

- 需要大量数据支持

📚 简单定义

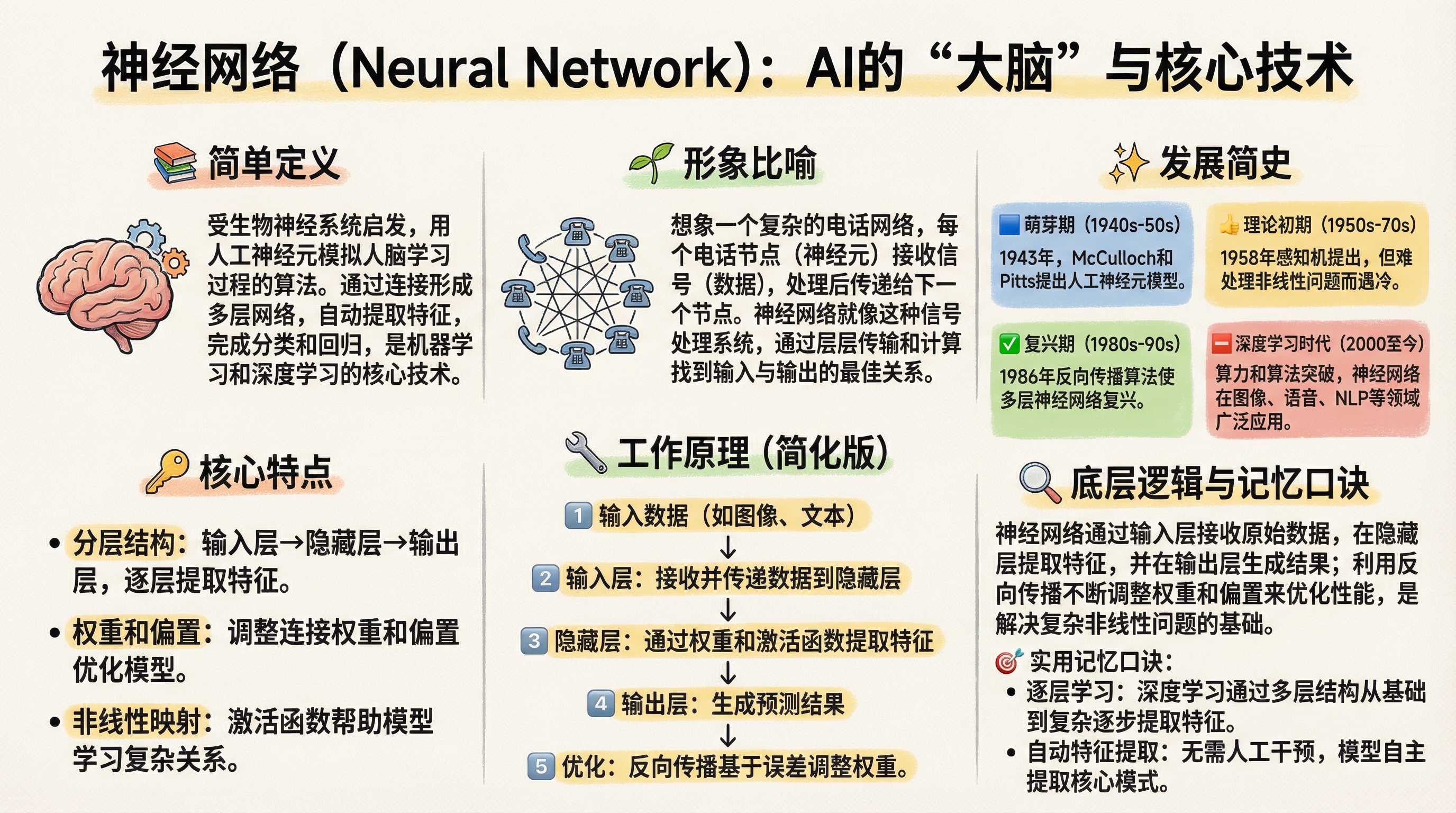

神经网络(Neural Network, NN)是一种受生物神经系统启发的算法,利用人工神经元模拟人脑的学习过程。通过连接成多层网络,它可以从数据中自动提取特征,完成分类、回归等任务,是机器学习和深度学习的核心技术之一。

🌱 形象类比

想象一个复杂的电话网络,每个电话节点(神经元)接收输入信号(数据),处理后再传递给下一个节点。神经网络就像这样的信号处理系统,通过层层传递和计算,找到输入与输出的最佳关系。

✨ 发展历史

🟦 萌芽阶段(20 世纪 40-50 年代) 1943 年 McCulloch 和 Pitts 提出人工神经元模型。

🟨 理论初探(1950-70 年代) 1958 年感知机问世,但无法处理非线性问题而遇冷。

🟩 复兴阶段(1980-90 年代) 1986 年反向传播算法推动多层神经网络复苏。

🟥 深度学习时代(2000 年至今) 算力与算法突破让神经网络广泛用于图像、语音、NLP 等领域。

🔑 关键特征

- 分层结构:输入层、隐藏层、输出层逐步提取特征。

- 权重与偏置:通过调整连接权重与偏置优化模型。

- 非线性映射:激活函数帮助模型学习复杂关系。

🔧 工作原理(简化版)

1️⃣ 输入数据(如图像或文本)

↓

2️⃣ 输入层:接收数据并传递到隐藏层

↓

3️⃣ 隐藏层:通过权重和激活函数提取特征

↓

4️⃣ 输出层:生成预测结果

↓

5️⃣ 优化:误差反向传播,调整权重

🔍 背后逻辑与工作机制

神经网络通过输入层接收原始数据,隐藏层提取特征,输出层生成结果;借助反向传播算法不断调整权重与偏置,以优化性能,成为解决复杂非线性问题的基础。

🎯 实用记忆小技巧

- 逐层学习:深度学习通过多层结构,从基础到复杂逐步提取特征。

- 自动化特征提取:无需人工干预,模型自行提炼核心模式。